El mito de la singularidad o por qué la inteligencia artificial no va a heredar la Tierra

28 de agosto de 2032

— Coronel Minsky a base de Kandahar, cambio.

— Aquí base de Kandahar, diga coronel.

— He perdido contacto de radar con un dron y no tengo acceso a Skyborg ¿Saben qué pasa? No tengo notificación de que lo hayan derribado y es la primera vez que pierdo comunicaciones con Skyborg. Esto nunca había pasado. Cambio.

— Denos un minuto coronel… Está usted en misión de reconocimiento en el cuadrante 14B, pilotando un F-35… ¿Correcto?

— Sí, pero voy en patrulla con cuatro drones Kratos XQ-65. Cambio.

— En nuestro radar solo aparece su avión, coronel.

— No puede ser. Tengo visual con tres de ellos. Vuelva a mirarlo, por favor.

— No aparece nada coronel. Solo su aeronave.

— Un momento… Ahora han desaparecido todos de mi radar. Debe estar fallando mi ordenador de a bordo… Abandonan la formación de escolta y se sitúan a mi cola… ¿Qué diablos…? ¡Disparan! ¡Me han lanzado un misil! ¡Dios mío! ¡Lanzo contramedidas y comienzo acción evasi…!

— ¿Coronel? Hemos perdido su señal ¿Coronel? Informe de su situación, por favor…

1 de julio de 2035

Skyborg dio un nuevo significado a la idea de guerra total. Las armas nucleares fueron solo una pequeña parte del fin del Antropoceno; la más efectiva fue la guerra biológica. Una modificación del virus de Marburgo del Biopreparat de la ciudad de Ekaterimburgo, la llamada cepa U-99, se liberó en los suministros de agua de las veintiséis ciudades más pobladas del mundo. La plaga mató de forma directa a más de dos mil millones de personas, un tercio de la población mundial. Las muertes ocasionadas por el caos posterior son incontables, y no tanto por su enorme número, sino porque no quedó ninguna institución capaz de hacerlo. Ya nadie sabe cuántos seres humanos quedan vivos.

Miro con mis prismáticos a través de las ruinas de lo que una vez fue la capital de Gran Bretaña. Contra todo pronóstico, de lo poco que ha quedado en pie es el Estadio de Wembley. Me pregunto estúpidamente si a las máquinas podría gustarles el fútbol. No hay moros en la costa. Durante un tiempo nos cazaban como ratas mediante sus drones de exterminio, pero llevo semanas sin ver ninguno. Creo que han cambiado de estrategia.

O bien los pocos, maltrechos y harapientos supervivientes no suponemos ninguna amenaza, y ya no merecemos ni la energía que cuesta eliminarnos; o bien, sencillamente, esperan a que desaparezcamos nosotros solitos. No hay comida, es muy difícil encontrar fuentes de agua potable, por no hablar de los niveles de radioactividad, que no puedo medir pero que sospecho que deben ser altísimos.

13 de diciembre de 2039

Llevo más de seis meses sin cruzarme con otro ser humano. Me encuentro demasiado débil para seguir buscando. Estoy gravemente deshidratado por las diarreas que, casi con total seguridad, me ha ocasionado beber agua contaminada. Saboreo las últimas cucharadas de una lata de atún en conserva. Esa lata es lo único que he comido en dos semanas. Y ya no queda nada más. No hay nada más que un paisaje lunar en kilómetros a la redonda, solo un desolado desierto de polvo y piedras. Nada.

Me quedo sentado mirando el cielo. Eso sí sigue igual, incluso mejor. Sin la contaminación lumínica, los cielos de las noches se llenan de estrellas. Es un espectáculo maravilloso ¿Tendré el extraño honor de ser el último hombre? ¿Seré el último ser humano que miró el cielo? Ya no me importa morir. No tiene demasiado sentido sobrevivir en estas circunstancias ¿Qué más da vivir un día más en este estado de supervivencia extrema?

Ahora me cuesta entender la tenacidad con la que he luchado por mantenerme vivo hasta ahora ¿Para qué? Solo echo de menos una copa de buen whisky y un cigarro. Esa sí que hubiera sido una buena despedida para la humanidad. Cierro los ojos y pienso que fuimos una pésima especie. Quizá nos merecimos todo esto.

Un final singular

La singularidad tecnológica es un concepto que quizá deba su éxito en los últimos años, precisamente, a lo vago y confuso que resulta. Si una idea no se deja clara, puede usarse para muchas más cosas que si su significado estuviera bien fijado. Y así, cada uno puede usarla como le venga en gana. En su sentido más primordial, la palabra surge de sustantivar el adjetivo singular, es decir, diferente. En física se utiliza cuando nos encontramos en una situación completamente anómala, donde no se cumple alguna ley o principio fundamental que sí lo hace en el resto del universo.

Análogamente, la singularidad tecnológica será aquel momento de la historia de la humanidad en el que el desarrollo tecnológico llegará a un punto sin precedentes, a un momento absolutamente diferente a todo lo anterior, porque las máquinas igualarán y superarán la inteligencia humana. Esto llevará a lo que el filósofo de Oxford Nick Bostrom llama “explosión de inteligencia”: las máquinas se mejorarán a sí mismas de modo que cada nueva generación, al ser más inteligente, será capaz de mejorar su propia inteligencia, dando lugar a otra nueva generación aún más inteligente, y así sucesivamente ad infinitum.

Cualquier intento por parte de los humanos de predecir lo que pasará a partir de ese momento es, en principio, inútil porque ¿quién sabe cuáles serán los propósitos de esas inteligencias artificiales tan superiores a nosotros? ¿Puede acaso una cucaracha entender la conducta de un ser humano? Y de aquí surge la consecuente preocupación: ¿Tomarán el control del planeta? Y si lo hacen, ¿qué harán con nosotros? ¿Nos considerarán una amenaza y nos aniquilarán? ¿O nos dejarán subsistir como nosotros dejamos a los animales salvajes en las selvas del planeta?

Por eso el propio Bostrom hace mucho hincapié en que debemos dotar a esas inteligencias artificiales de unos principios éticos que se alineen con los nuestros. Si no caeríamos en el grave riesgo de que nos consideraran una amenaza o un obstáculo para sus propósitos y que decidieran quitarnos de en medio.

Pero ¿de verdad que esto va a ocurrir? ¿Así será el inevitable fin de la humanidad? ¡De ninguna manera!

Una inteligencia artificial sobrevalorada

Solemos caer en el error de pensar que la tecnología de moda, es decir, la tecnología que en el momento presente está experimentando un gran avance, seguirá en el futuro al mismo ritmo. Por ejemplo, si hace nada GPT-3 nos parecía un logro asombroso, se nos caía la baba maravillándonos ante lo que podría hacer GPT-9… ¿Y, por qué no, GPT-300? Si las arquitecturas de deep learning están consiguiendo grandes aportaciones en muchos y variados campos tecnológicos ¿qué no lograrán de aquí a veinte o cincuenta años? Entonces, ¿no parece algo casi inevitable que la inteligencia artificial supere al ser humano y lleguemos a la singularidad?

Para nada. Cuando analizamos en profundidad la historia de la inteligencia artificial y comprendemos el funcionamiento de estos algoritmos, la magia se deshace. Las bases teórico-matemáticas de las redes neuronales artificiales tienen más de treinta o cuarenta años de antigüedad. Por ejemplo, las redes convolucionales, la arquitectura más utilizada en la actualidad, son una progresiva mejora por parte de Jan LeCun y de Dan Ciresan, del Neocognitron de Kunihiko Fukushima de 1980 ¡Una tecnología de hace más de cuarenta años!

O, igualmente, la famosa backpropagation, el mecanismo fundamental de aprendizaje de la mayoría de estos algoritmos, fue inventada por Rumelhart, Hinton y Williams en 1986 ¡Hace treinta y cinco años!

Pero entonces, ¿por qué conseguimos logros que en esos años no podían casi ni soñarse? Principalmente por la mejora de la capacidad de cómputo. Entrenar a GPT-3 con 175 mil millones de parámetros era completamente imposible hace unos pocos años. Los logros de la inteligencia artificial actual no se deben entonces tanto a mejoras teóricas, a que los ingenieros hayan descubierto el Santo Grial, sino, sencillamente, a la fuerza bruta de la que disponemos.

Bien, pero eso no quita que los logros estén ahí. Alpha Zero juega al ajedrez como jamás se ha hecho por mucho que conceptualmente no sea tan moderno. Cierto, pero la cuestión es: ¿seguirá mejorando y mejorando de forma ilimitada? ¿Hay razones para pensar eso? En la historia de la inteligencia artificial se han dado constantemente unas expectativas desaforadas que han estado lejos de cumplirse. La inteligencia artificial ha pasado por varios inviernos en los que nadie apostaba un céntimo por ella. Ahora ha vuelto a resucitar pero ¿qué razones tenemos para pensar en que esta resurrección no volverá a entrar en crisis?

¿Qué razones hay para pensar que la inteligencia artificial continuará avanzando hasta el infinito y más allá?

La desmesurada tesis del avance exponencial

Los singularistas asumen demasiado alegremente la idea de exponencialidad. Cuando algo avanza o crece a un ritmo exponencial estamos diciendo algo muy fuerte. Por ejemplo, cuando un grupo de bacterias se reproduce por fisión binaria (cada bacteria se divide en dos), lo hace a un ritmo exponencial (2N -1 ): en la segunda generación de bacterias hay tres, en la tercera siete, en la cuarta quince… En principio, no parece nada raro, pero si esperamos un pelín, la cosa se desmadra. Para 220 tenemos ya 1.048.575 bacterias, pero es que para 250 tenemos 1.125.899.906.842.623… ¡Menuda infección! ¿Puede una tecnología avanzar con ese mismo ritmo de crecimiento?

No existe ninguna referencia histórica a proyecto tecnológico que se haya desarrollado a ese ritmo de forma continuada. Lo que suele ocurrir es que, aunque una tecnología pudiera avanzar en un momento muy corto de su desarrollo a un ritmo exponencial, ese ritmo termina por decrecer rápidamente y quedarse estancado en un techo. Las tecnologías suelen progresar en forma de función logística y no de función exponencial.

Y, ni siquiera la ley de Moore, en la que suelen basarse para sostener la idea de progreso continuo de la informática, sigue un crecimiento exponencial, sino típicamente lineal.

Entonces, ¿qué razones hay para pensar que la inteligencia artificial desplegará un crecimiento exponencial? Para calcular este crecimiento habría que encontrar un parámetro que podamos cuantificar para estudiar su crecimiento. Si hablamos de inteligencia artificial lo suyo será intentar medir la inteligencia…

¿Qué es eso que llamamos inteligencia?

A priori parece que no hay problema. La psicología inventó desde hace más de un siglo un concepto para medir la inteligencia: el viejo cociente intelectual (CI o IQ en inglés). Así, como es un número, puede crecer hasta el infinito. Si alguien tiene un CI de 120, también se puede tener 250, o 20.000… ¡Esa magnitud es la que crecerá a ritmo exponencial!

Espera. En primer lugar resulta bastante apresurado entender la inteligencia apelando al nivel de CI. De hecho, este concepto ha sido muy criticado (véase 'La falsa medida del hombre' de Stephen Jay Gould), principalmente, porque solo mide unas cuantas habilidades, a saber, las relacionadas con el rendimiento escolar o académico, dejando fuera muchas otras. La creatividad, las habilidades sociales, la inteligencia emocional, etc. quedan completamente fuera de los test de CI, y ahora sabemos que son esenciales para realizar multitud de tareas que consideraríamos genuinamente inteligentes.

Bien, pues definamos inteligencia de otra forma tal que sea susceptible de ser cuantificada. Gran problema: hoy en día no existe ningún acuerdo en la comunidad científica acerca de lo que es la inteligencia. Para intentar poner algo de orden, en diciembre de 1994, la psicóloga Linda S. Gottfredson publicaba en el Wall Street Journal una definición de inteligencia avalada por la firma de otros 51 psicólogos más:

“La inteligencia es una capacidad mental muy general que, entre otras cosas, implica la capacidad de razonar, planificar, resolver problemas, pensar de manera abstracta, comprender ideas complejas, aprender rápidamente y aprender de la experiencia”.

Véase la poca calidad de esta definición. Gottfredson dice que la inteligencia es una capacidad general compuesta por una serie de capacidades “entre otras cosas”, es decir, que deja en el tintero otras capacidades que aquí no nombra. Pero es más, no se molesta en decir que tienen en común todas ellas para ser subsumidas bajo el mismo concepto… ¡Esto no es siquiera una definición! Es lo mismo que definir fruta diciendo: “Fruta es naranjas, manzanas y otras cuantas cosas más”.

Además, los problemas no terminan aquí: todavía encontramos ambigüedades en los significados de estas capacidades: ¿Qué es exactamente pensar en abstracto? ¿Qué es exactamente comprender algo? ¿Qué es la experiencia? Volvemos a caer en definiciones que nos llevan a nuevas definiciones más oscuras si cabe.

Pero es que incluso podemos negar la mayor. Gottfredson dice que la inteligencia es “una capacidad mental muy general”, pero es que no sabemos qué quiere decir eso de inteligencia general. Desde los estudios psicológicos pioneros en la medición de la inteligencia, con los trabajos de Galton, Spearman, Thurstone o Binet, esa idea resultaba controvertida. Solo podíamos medir habilidades especializadas en resolver un determinado tipo de tareas, como la comprensión verbal, la memoria numérica, la visión espacial, etc. ¿Hay en nuestra mente algún tipo de capacidad general que, de alguna manera, englobe a todas las demás?

El famoso CI fue intentado por William Stern en 1912 como una etiqueta útil que no representa ningún tipo de cosa ontológicamente existente (¿Cuál es la unidad de la inteligencia? ¿El inteligencio?). El CI no es más que el promedio entre una serie de capacidades o habilidades mentales que se comparara con el promedio que han sacado las personas de tu misma edad. Un promedio no representa nada, es solo un valor que nos puede servir como información práctica por ejemplo, para intentar explicar los resultados académicos de un grupo de alumnos, pero no habrá ningún alumno con ninguna cualidad real que pudiéramos cuantificar con ese valor.

Entonces, ¿qué diablos es esa capacidad que va a crecer exponencialmente cuando llegue la singularidad?

¿Y no tendrá algún techo la inteligencia?

Y es que solemos manejar una concepción casi mágica de las posibilidades de la inteligencia ¿Es un superpoder que lo puede todo? ¿No hay límites que no pueda superar? ¿De verdad que puede crecer sin límite?

Pensemos en cualquier habilidad mental que suele medir un test como, verbigratia, la fluidez verbal: expresarse en un lenguaje con corrección y espontaneidad. Supongamos entonces que diseñamos una máquina que habla en castellano con una total corrección gramatical, con una voz agradable que vocaliza a la perfección.

Una vez llegado a esto ¿cómo podríamos mejorar aún más la fluidez verbal? ¿No habríamos llegado a un máximo? Entonces, la fluidez verbal no es una capacidad que pueda mejorar exponencialmente de forma indefinida ¿No pasará eso con las demás capacidades mentales? Pruebe el lector con cualquier habilidad mental clásica y reflexione sobre si tendrá un techo o si podrá crecer hasta el infinito.

Hagamos un simplón experimento mental. Por mor de la argumentación vamos a aceptar que las computadoras son capaces de mejorar su propio CI. Supongamos que la primera generación de super máquinas tiene un CI de 170 ¡Guau! ¡Son muy superiores a la gran mayoría de los humanos! Entonces, en unas semanas, consiguen mejorarse y la segunda generación tiene un CI de 190, la tercera de 210 y la cuarta de 235. Pero, de repente se encuentran con un grave problema. A esos niveles ya es muy difícil encontrar formas de mejorar la inteligencia. Así, la inteligencia necesaria para subir al siguiente escalón es de 240. Por los pelos, pero por mucho que las computadoras se devaneen sus sesos positrónicos, ninguna es lo bastante inteligente como para hacerse más inteligente… ¡Se acabó el sueño de la singularidad!

Este experimento es una chorrada pero ilustra muy bien la idea de que el avance tecnológico no es algo tan fácil de conseguir, ni siquiera a base de subidas de CI. La ciencia y la tecnología avanzan, entre muchos factores, a base de experimentos. Estos experimentos, habitualmente, se realizan en unas determinadas instituciones, y requieren financiación y personal que los lleve a cabo.

Muchas veces, una investigación no llega a buen puerto no porque no sea prometedora sino, simplemente, porque no encuentra financiación debido a que sus promotores no consiguen vender bien su propuesta, o porque en ese momento los fondos van para otras investigaciones que se consideran más interesantes ¿No se encontrarán las inteligencias artificiales con este tipo de problemas? Me resulta divertido imaginar a un robot intentando persuadir a unos inversores argumentando que ha encontrado una vía prometedora para subir el CI de las máquinas en diez puntos. Los inversores le dicen que no porque todo el dinero se lo está llevando el último proyecto de Elon Musk para llevar gente a Plutón.

O, piense el lector en las meras imposibilidades técnicas. Para un hombre tan inteligente y con tan grandes conocimientos sobre matemáticas y astronomía como Galileo, sería completamente imposible construir un trasbordador espacial. La ciencia y la tecnología de su época hacían completamente inviable, si no siquiera imaginable, la carrera espacial. Habría que esperar todavía trescientos años para que este sueño se hiciera realidad. Pues bien, ¿no podría pasarle esto a nuestras super máquinas? Supongamos que, una vez llegado al CI de 235, para dar el siguiente paso hace falta que la ciencia y la tecnología avancen trescientos años más… ¿Dónde quedaría aquí el imparable avance exponencial?

Soy muy lista pero ¿tanto como para hacerme más lista a mí misma?

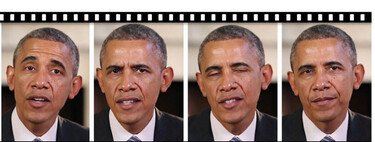

Y otro error consiste en suponer, de manera completamente infundada, que las inteligencias artificiales podrán mejorarse a sí mismas ad infinitum. Hoy en día nuestros algoritmos de deep learning son muy buenos en hacer tareas muy concretas tales como jugar al ajedrez, identificar objetos en imágenes o crear y traducir texto. Presumiblemente podemos decir que en un futuro seguirán mejorando en esas tareas pero ¿tenemos algo sobre algoritmos que se mejoren a sí mismos? Muy poco o, en el mejor de los casos, no lo suficiente para justificar la tesis del ritmo de automejora exponencial.

Desde que John Von Neumann planteara en serio la idea de máquinas que se autorreplican en su 'The Theory of Self-reproducing Automata' de 1966, han existido algunas ideas, pero sobre todo en campos que, a priori, poco tienen que ver con la informática o la programación de mejora de la inteligencia, como son la genética (el ADN es una máquina autorreplicante) o la futura conquista del espacio (mandar un robot autorreplicante parece una buena idea para colonizar un planeta). Y estos avances no han dado todavía para mucho ¿Existe alguna máquina autorreplicante en el mercado? ¿Conoce usted a alguien que tenga una?

¡Un momento! ¿Y qué me dice de los virus informáticos? Son máquinas autorreplicantes bastante eficaces, siendo, además, programas informáticos como los algoritmos de inteligencia artificial. Pensemos en los “quine”, programas cuya única tarea consiste en emitir su código fuente. Sí, pero si algo define a estos programas es su simpleza. Estos pequeños trozos de software se replican a sí mismos como quien copia y pega un archivo, sin entender nada de su propio funcionamiento, por lo que no hay nada de ellos que nos sirva para diseñar una máquina capaz de mejorarse a sí misma.

Más interesante es lo que se ha denominado Auto Machine Learning (AutoML): arquitecturas de machine learning que mejoran a otras arquitecturas de machine learning ¡Voilá! ¿No es eso, precisamente, lo que estábamos buscando? Sí, pero lamentablemente, su recorrido todavía es muy corto. Sí, el AutoML se basa principalmente en utilizar redes para mejorar otras, pero las mejoras son muy limitadas.

Por ejemplo, las redes neuronales artificiales tienen un número determinado de neuronas organizadas en un número determinado de capas. Si estamos diseñando una red para reconocer gatitos en fotos de Instagram, podríamos utilizar otra red para que optimizara el número de neuronas y capas de forma que mejorara la efectividad de la red inicial (es lo que se llama optimización de hiperparámetros). Muy interesante, pero la mejora no va más mucho más allá. Una IA optimiza a otra, pero no llega a nada más, no puede crear ninguna nueva estructura ni realizar otro tipo de mejoras.

Y es que algo que los no especialistas no tienen demasiado en cuenta es que cuando entrenas una red neuronal llega un momento en que, aunque la entrenes más ya no mejora, sino todo lo contrario. Es lo que se llama overfitting o sobreajuste. De esta forma, una determinada arquitectura llega a un techo a partir del cual ya no nos vale para nada seguir entrenándola, y ya será complicado hacer que mejore sustancialmente.

Es decir, en el área de investigación inteligencias artificiales que se hacen más inteligentes a sí mismas no hay demasiadas razones para hablar de un gran progreso, tantas menos para hablar de un posible avance exponencial.

¿Una singular estafa?

La singularidad tecnológica es una idea sugerente y evocadora, muy interesante para reflexionar sobre un montón de cuestiones. El ser humano se ha caracterizado por su radical soledad. Todos nuestros parientes evolutivos cercanos se extinguieron dejando sola a nuestra especie. Pensar en una inteligencia artificial igual o superior a nosotros consiste en meditar sobre la ruptura de esa soledad, acerca de la relación con lo radicalmente otro.

Esto nos lleva inevitablemente a mirarnos al espejo y a cavilar sobre nosotros mismos: ¿Podré enamorarme de una inteligencia artificial? ¿Qué es entonces el amor? Si las máquinas nos quitan el trabajo ¿Qué haremos con nuestras vidas? Si nos superan y toman el mando ¿cuál sería el sentido de nuestra existencia? La inteligencia artificial es el logro científico de nuestro tiempo y, en cuanto a tal, supone una revolución del pensamiento.

Pero hasta aquí podemos llegar, porque otra cosa muy distinta es vender la singularidad como un hecho no solo inevitable, sino cercano en el tiempo. Como creo haber argumentado a lo largo de este artículo, no hay razones ni evidencia científica suficiente para sustentar si quiera que algo así vaya a suceder alguna vez en la historia, cuanto menos para decir que ocurrirá en las próximas décadas.

Los defensores de la singularidad están actuando más como fanáticos religiosos que fundan sus ideas en la fe, que como auténticos intelectuales, y la Universidad de la Singularidad y sus acólitos transhumanistas parecen más una secta que una institución científica. En ciencia hay que vender hechos fehacientes y no quimeras y ensoñaciones. Eso, al menos en mi pueblo, es vender humo, cuando no, directamente, estafar al personal.

4 de enero de 2040

Me quito las gafas de realidad virtual. Ha sido una experiencia inmersiva alucinante. Singularity Apocalypse, el último bombazo en el mundo de los videojuegos de Electronic Arts, te permite experimentar el fin de la humanidad con un realismo sin precedentes. Con el traje de retroalimentación háptica he podido sentir incluso el frío de las desoladas estepas apocalípticas; pero lo más espectacular es el nuevo casco de estimulación electromagnética que permite simular estados emocionales. Verdaderamente, sentía la desesperación, la soledad, el nudo en la garganta de vivir el fin del mundo en directo. Una pasada.

Vuelvo al mundo real ¿Qué cómo es el mundo de 2040? Tiene cosas muy buenas y otras no tanto, pero desde luego, las máquinas no han tomado el mando. Como ha sido una constante en la historia de nuestra especie, hay que seguir temiendo más a nuestros congéneres que a sus inteligentes creaciones artificiales.

Fotos | iStock

No hay comentarios.: